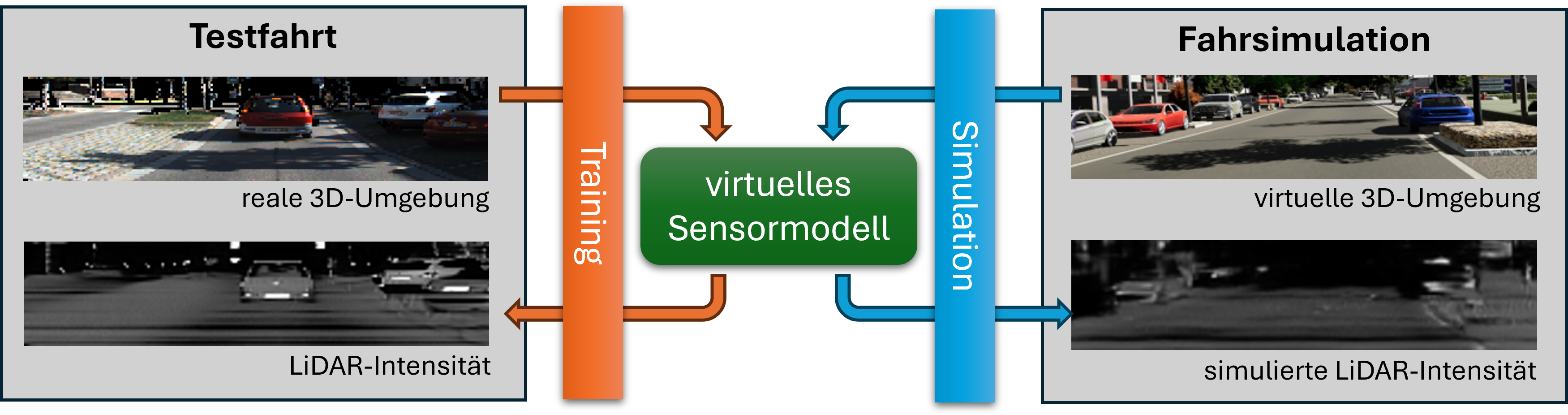

Für die Entwicklung und das Testen autonomer Fahrzeugfunktionen ist die virtuelle Fahrsimulation wesentlicher Bestandteil. Die Simulation der Sensorik eines (autonomen) Fahrzeuges spielt dabei eine besondere Rolle. Benötigt wird eine virtuelle Sensorsimulation, die auch die typischen Grenzen und Fehler des Sensors realitätsnah abbildet.

Ziel des Projektes war es, realistische Sensormodelle aus Realdaten abzuleiten. Aus bei Testfahrten erhobenen Datenströmen (von Kameras, LiDAR, Radar, GPS etc.) sollte ein 3D-Modell der Umgebung gewonnen werden, darauf aufbauend das Verhalten der Fahrzeugsensorik mit einer physikalischen Simulation abgeglichen und ein realitätsnahes virtuelles Modell des Sensors abgeleitet werden, das dann in der virtuellen Fahrsimulation verwendet werden kann (s. Abb.).

Auf dem einschlägigen Forschungsgebiet gab es im Lauf des Projektes vielfältige technische Weiterentwicklungen, die große Auswirkungen auf den Projektverlauf hatten. Mit Hilfe neuester Verfahren zur Bildtransformation wurde es möglich, in virtuellen Testumgebungen die Ergebnisse eines Sensors direkt aus (simulierten) Kamerabildern vorherzusagen. Mit sogenannten Neural Radiance Fields konnten detailreiche Rekonstruktionen der 3D-Umgebung von Testfahren generiert werden, wodurch es möglich wurde, das physikalische Verhalten der Sensoren genau zu erfassen. Außerdem ist es gelungen, bisher nicht berücksichtigte technische Eigenschaften von LiDAR-Sensoren zu rekonstruieren und physikalisch-basiert auch in die Sensorsimulation mit einzubeziehen. Das Sensormodell wurde in die virtuelle Simulationsumgebung CARLA integriert und unter anderem anhand eines Abstandreglers evaluiert.